Capitalismo de Vigilancia

En materia de desafíos éticos, las Big Tech tienen mucho por hacer, y la evidencia reciente demuestra que están al debe…

En los últimos años, el desarrollo tecnológico ha producido espectaculares avances en diferentes ámbitos, pero muchos de estos avances han planteado diversos desafíos a las políticas públicas en materias de: inclusión, acceso, seguridad y protección de datos.

La constante digitalización de la sociedad ha empujado a los estados a replantearse ideas y a preguntarse ¿cómo responden estos avances a esos desafíos?

Recientemente, las preguntas en torno al uso ético de los datos, la protección de la vida de las personas y su entorno son cada vez más frecuentes, y no hemos podido dar respuestas adecuadas.

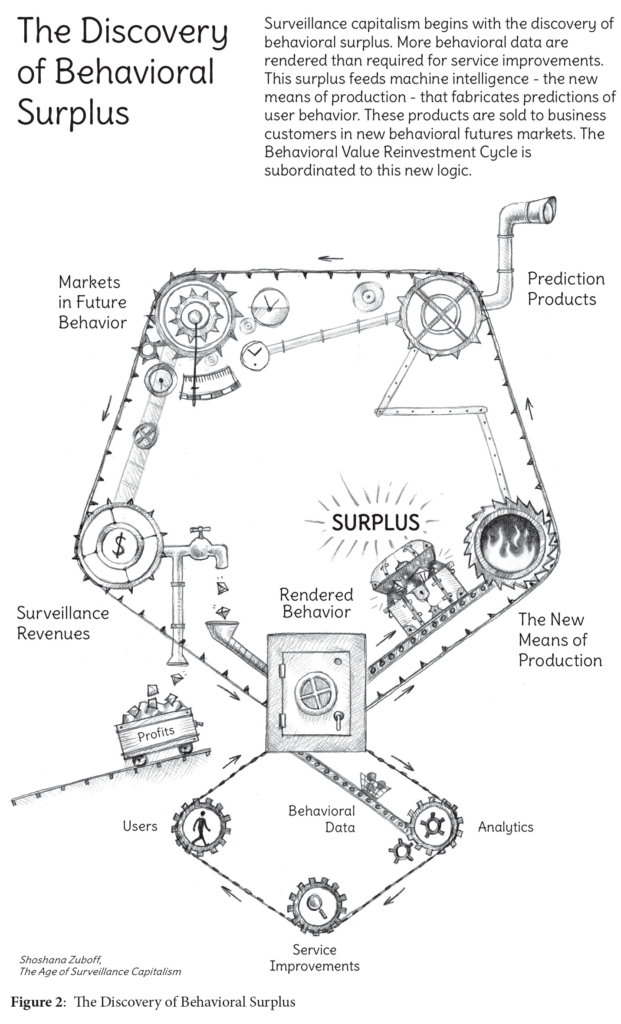

Quiero mencionar en este artículo, el gran libro de Shoshana Zubofff, The Age of Surveillance Capitalism (La era del capitalismo de vigilancia), título que a estas alturas se ha transformado en un clásico en materias de uso de datos por parte de las grandes tecnológicas, en particular Google y Facebook.

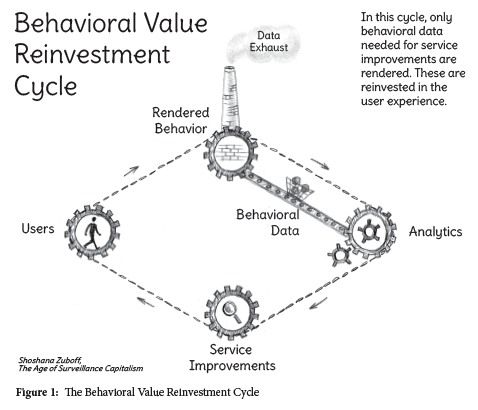

El concepto capitalismo de vigilancia acuñado por Zuboff, plantea que a comienzos de los 2000 Google, descubrió que la captura de datos de comportamiento de sus usuarios , el cual tenía como objetivo mejorar los servicios, podía ser usado para otros fines.

Este descubrimiento casi por casualidad, el cual podríamos decir se produjo por efecto serendipia, es decir, un descubrimiento o hallazgo afortunado, valiosos e inesperado que se produce de manera accidental o casual. Lo cual es bastante contradictorio con el propio Google, ya que ese buscador potencia la reducción de la serendipia con su efecto de burbuja señalado por Eli Pariser en 2012.

Capitalismo de Vigilancia

El capitalismo de vigilancia consiste en “la extracción, sin consentimiento por parte de los usuarios, de los metadatos asociados a sus interacciones con servicios digitales o aparatos inteligentes».

Estos datos, capturan todo tipo de información: fecha, hora, idioma, localización geográfica, frecuencia, contenido, perfil de navegación, todos estos datos y muchos más agregados en un nivel de escala no pensado antes (cientos de millones de usuarios), permiten desarrollar perfiles y modelar sistemas predictivos de conducta muy confiables, lo que algunos llaman la primera ola de la Inteligencia Artificial, o la IA de Internet, la cual se basa en el uso de algoritmos de IA como motores de recomendación (predicciones de comportamiento).

El resultado de estas predicciones de comportamiento son un activo que se venden a anunciantes como una forma de mejorar sus sistemas de marketing, desarrollando publicidad totalmente personalizada.

En la actualidad la cantidad de datos extraídos es tan grande que la publicidad ya no solo muestra artículos personalizados a los usuarios, sino que puede predecir el estado sentimental de estos para saber cuando mostrar dichos artículos.

Dicho control aumentó explosivamente en la década del 2010 cuando las empresas dueñas de los servicios digitales se dieron cuenta de que, mediante el uso de los datos de los usuarios, y la comprensión de su comportamiento a nivel social, podían llegar al punto máximo de poder, modificar la conducta humana. Un buen ejemplo de esto fue el boom del juego basado en realidad aumentada Pokemon Go en 2016.

Este juego fue diseñado y desarrollado por Google bajo el mando de John Hanke, fue liberado Niantic Labs, la empresa emergente perteneciente a Google y que servía de pantalla para disimular el verdadero origen del juego, grandes masas de gente empezaron a salir a las calles en busca de las criaturas virtuales, pero lo que no sabían es que este juego también servía como forma de control e incentivo al consumo.

Al igual que en la publicidad personalizada, las empresas y compañías podían contratar servicios de la app para que mediante el uso de los datos recolectados pudieran acrecentar sus ganancias. Así, pagaban para que “los pokemón” aparecieran en lugares de venta estratégicos. Por ejemplo, si Starbucks contrataba este servicio, distintos pokemón aparecían fuera y dentro de sus locales de ventas, haciendo que la gente, una vez habiendo atrapado a la criatura, se motivara a comprar un producto en el local.

Las Big Tech y lo que se viene

Todo esto y muchos otros efectos no hacen mas que demostrar que el comportamiento de las llamadas Big Tech, están llegando a un punto en el cual, nuestras sociedades deben pronunciarse, y buscar mecanismos para su control y condiciones mínimas que no atenten contra la libre competencia, la libertad de expresión, pago de impuestos y muchos otros.

Es así como hemos visto iniciativas en diferentes países vinculadas a esas áreas, tales como:

- Regulaciones impositivas a las Big Tech por parte de Francia, o los llamados impuestos GAFA

- Unión Europea y sus casos contra Google por afectar la libre competencia

- Regulación australiana por el uso de contenidos de otros medios de comunicación por parte de Facebook en los que también estaba involucrado Google pero decidió pagar.

- Juicios y casos antimonopolio de Google en Estados Unidos

Pero estos desafíos no sólo dicen relación con el mejoramiento de los marcos legales y normativos, muy necesarios por cierto, sino que plantean desafíos en la ética de esos negocios. Hoy por hoy existen muchas objeciones al comportamiento de esas empresas, y las exigencias éticas que suponen estos negocios, incluso algunas han desarrollado áreas vinculadas a la ética, incluso el propio Google estableció una área, pero en los últimos días las cosas no se ven muy bien, descabezando al equipo que lideraba el área de ética vinculada a la inteligencia artificial de esa compañía de una forma muy poco ética.

En estos ámbitos está todo por construir, y tanto la Sociedad Civil como los Estados tienen un rol fundamental, regulando, monitoreando y recomendando estándares de conducta mínimos.

Imagen: https://fivemedia.com/gallery/the-future-as-seen-from-the-past/