ChatGPT, ¿qué tanto de hype?

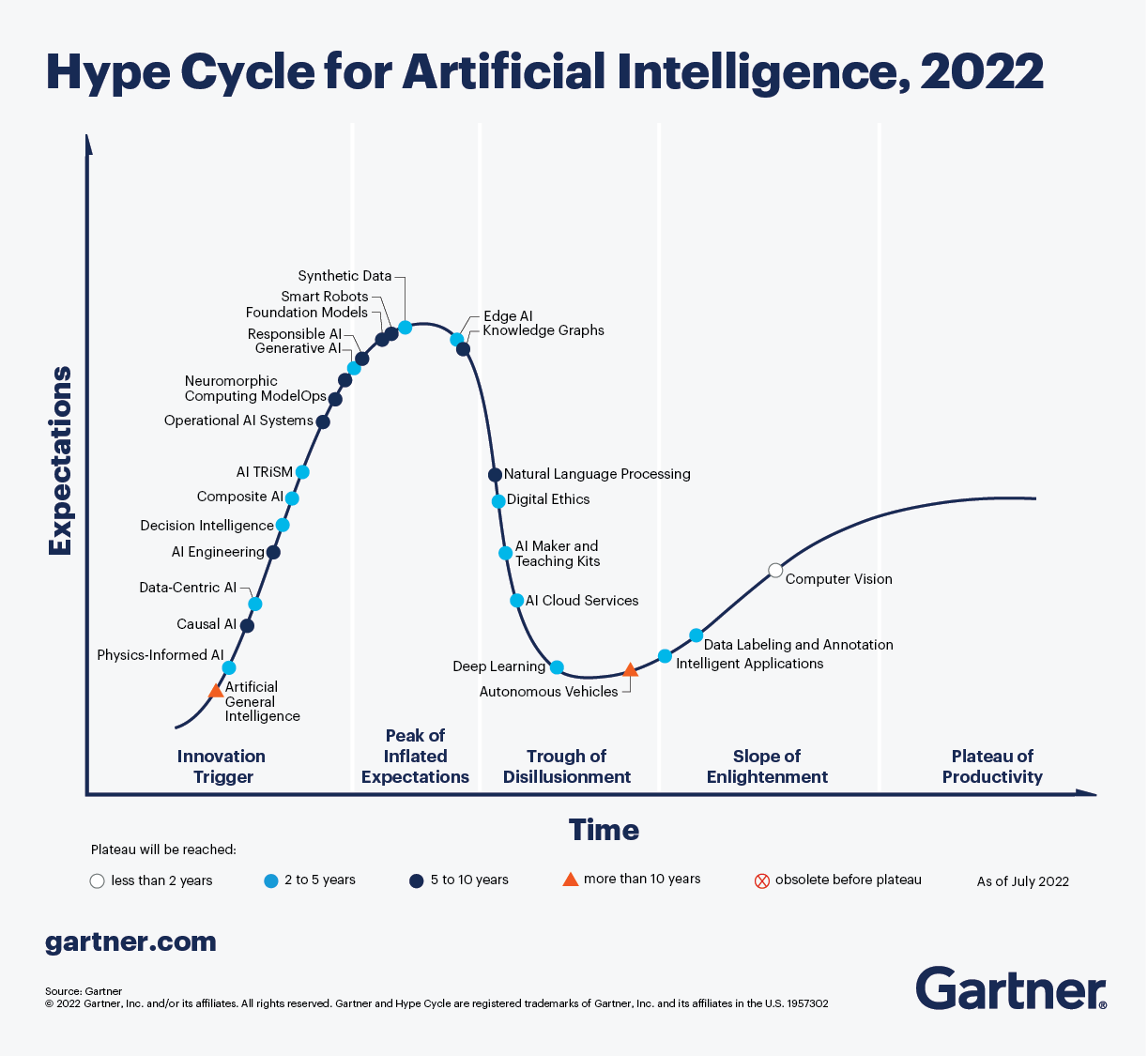

ChatGPT y Dall-E son herramientas de la Generative AI, que se encuentran en lo más alto de la Hype-Curve, planteando numerosas preguntas, de las cuales muchas aún no tienen respuesta convincente!

Desde que se lanzó la aplicación ChatGPT en noviembre de 2022, esta ha generado múltiples reacciones, y al igual como lo fue la aplicación Dall-E (generador de imágenes basados en en Inteligencia Artificial). Ambas tecnologías forman parte de lo que se conoce como Generative AI (IA generativa), tecnologías que permiten producir texto e imágenes.

El software utiliza modelos complejos de aprendizaje automático para predecir la siguiente palabra en función de secuencias de palabras anteriores, o la siguiente imagen en función de palabras que describen imágenes anteriores, Thomas H. Davenport de la Harvard Business Review plantea grandes desafíos en el trabajo creativo. El mismo google muestra el crecimiento de las búsquedas en esta materia en los últimos meses, en la gráfica se ve una comparación entre el patrón Ukraine y ChatGPT.

ChatGPT y el Hype

Como en el pasado, cuando hace irrupción una nueva tecnología, se produce un efecto que muestra diferentes percepciones, desde la fascinación, hasta el temor por los efectos potenciales de su uso, algunos ejemplos de uso de ChatGPT (WhatsApp, Google Crome, Excel).

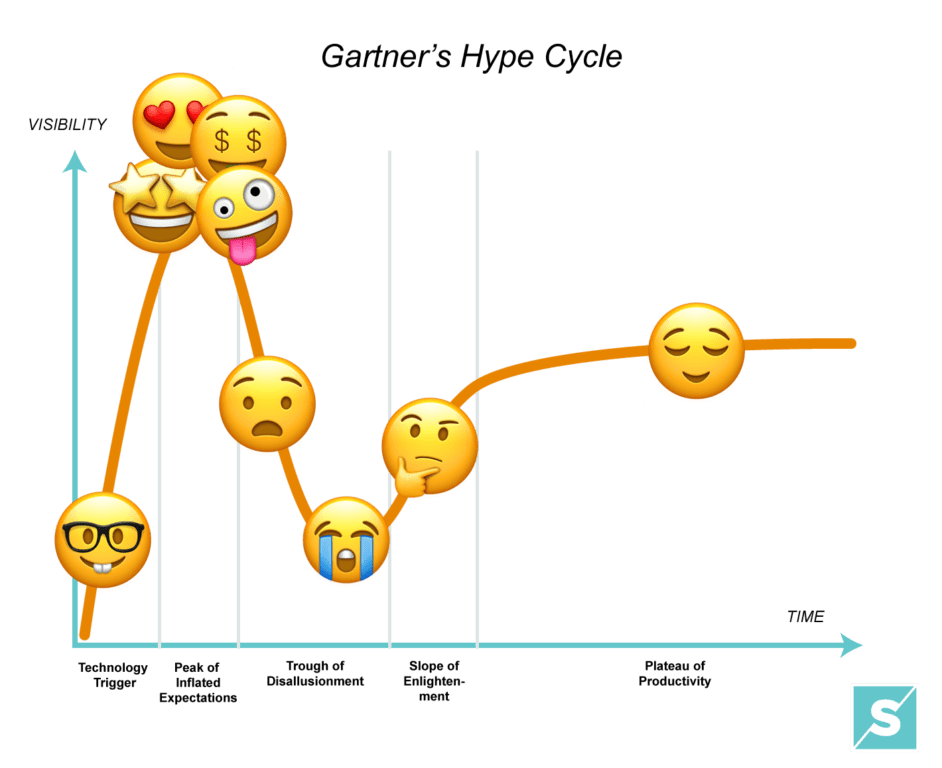

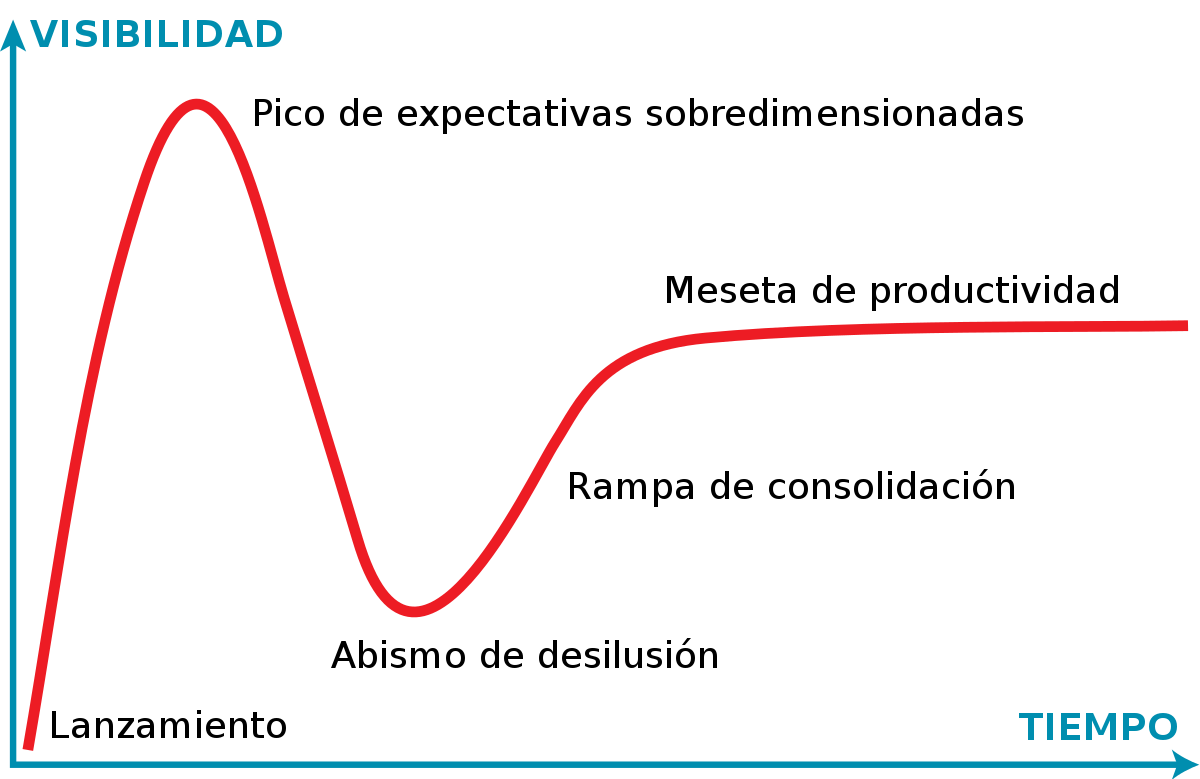

Estas reacciones, son un fenómeno bastante estudiado, incluso la consultora Gartner le dio un nombre, el ciclo y/o efecto hype. Este ciclo lo muestra a través de un gráfico, la denominada hype-curve, la cual muestra que las tecnologías emergentes pasan por cuatro estados hasta llegar a su nivel de madurez:

- Lanzamiento

- Pico de expectativas sobredimensionadas

- Abismo de desilusión

- Rampa de consolidación

- Meseta de productividad

El paso por cada una de estos estados, puede durar bastante tiempo, incluso hay algunas tecnologías que mueren antes de llegar a la meseta de productividad. De hecho Gartner, el año 2022, ubicaba la tecnologías Generative AI entrando a lo más alto del pico de expectativas de la Hype-Curve.

¿Qué pasa con ChatGPT?

Se trata de una tecnología desarrollada en 2022, por la empresa OpenAI, la misma empresa que desarrolló Dall-E en enero de 2021.

OpenAI define a ChatGPT, como la optimización de modelos lingüísticos para el diálogo. Para ello desarrollaron un modelo que interactúa de forma conversacional. El formato de diálogo hace posible que ChatGPT responda a preguntas.

Como opera

El modelo actual de ChatGPT está basado en la tecnología GPT-3 (Generative Pre-trained Transformer 3), esto es, un modelo de lenguaje autorregresivo que utiliza aprendizaje profundo para producir textos que simulan la redacción humana sobre la base de un análisis de grandes volúmenes de datos.

OpenAI utilizó trabajadores kenianos pagando menos de 2 dólares por hora para hacer menos tóxico ChatGPT

Time

Los grandes modelos lingüísticos (Large Language Model), como el GPT-3, se entrenan con grandes cantidades de datos de texto de Internet y son capaces de generar textos similares a los humanos, pero no siempre producen resultados coherentes. La función objetivo que utilizan es una distribución de probabilidades sobre secuencias de palabras, que les permite predecir cuál es la siguiente palabra de una secuencia, mientras más datos de entrenamiento se utilicen mejor es la predicción. Algunos de los problemas que tienen estos modelos son:

- El modelo inventa hechos inexistentes o erróneos.

- El lector del resultado no entiende como el modelo llegó a ese resultado/decisión

- Entrega resultados diferentes en función del usuario que pregunta, incluso si cambio de disposituvo cambia respuesta, me hizo recordar el análisis de Google y Facebook de Eli PAriser en su buen libro The Filter Bubble

- Resultados sesgados o francamente tóxicos, un modelo lingüístico entrenado con datos sesgados puede reproducirlos en sus resultados. De hecho según la publicación Times, OpenAI utilizó trabajadores kenianos pagando menos de 2 dólares por hora para hacer menos tóxico ChatGPT.

Un interesante análisis sobre como opera ChatGPT es el paper Entrenamiento de modelos lingüísticos para seguir instrucciones con retroalimentación humana y este artículo en ScienceFocus de la BBC.

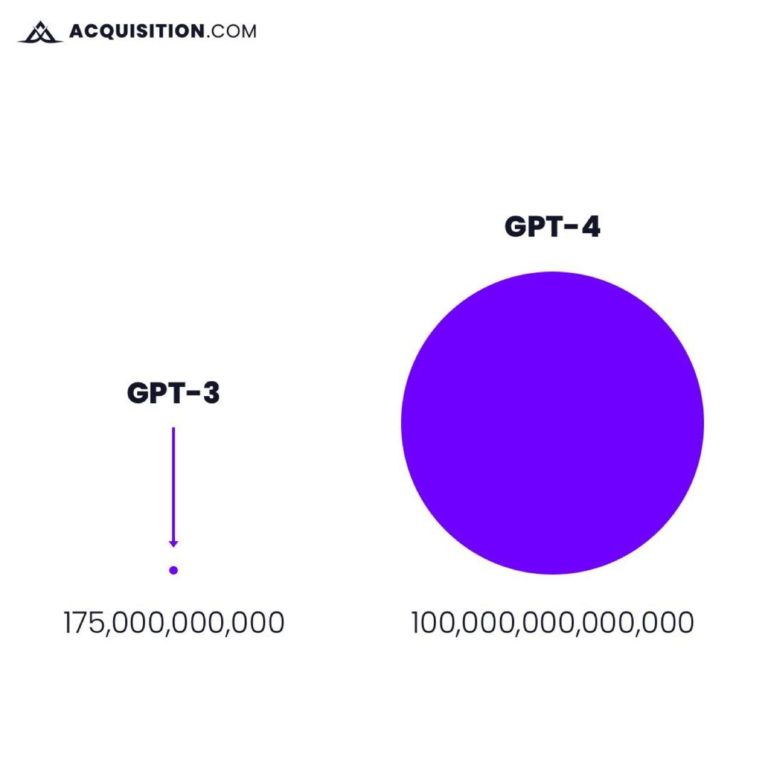

El GPT-3 (versión actual) por su parte fue entrenado con 175 mil millones de ejemplos según Acquisition.com. Actualmente OpenAI se encuentra desarrollado una nueva versión basada en GPT-4 que está siendo entrenado con 100 billones de ejemplos (está gráfica se la robé a Jaime Navón).

Si bien son varios órdenes de magnitud mayor el volumen de datos de entrenamiento para la nueva versión, se espera que su comportamiento mejore en forma significativa, aunque algunos expertos plantean dudas y reparos respecto de las mejoras, ya que no se sabe exactamente cuanto más conocimiento hay en los ejemplos nuevos, podría no haber nada muy nuevo y solo aumentar el nivel de ruido.

¿Que se viene por delante?

Desde un punto de vista de su evolución futura, múltiples autores de prestigiosas universidades plantean algunos análisis de la posible evolución de estos modelos, en su paper “Disociar lenguaje y pensamiento en los grandes modelos lingüísticos: una perspectiva cognitiva”, los autores plantean que los grandes modelos lingüísticos (LLM) actuales generan de forma rutinaria párrafos de texto coherentes, gramaticales y aparentemente con sentido. Este logro ha llevado a especular con que estas redes son -o pronto serán- «máquinas pensantes», capaces de realizar tareas que requieren conocimiento y razonamiento abstractos.

Para ello realizaron pruebas y sostienen que: i) los LLM contemporáneos deberían tomarse en serio como modelos de competencias lingüísticas formales; ii) los modelos que dominan el uso del lenguaje en la vida real necesitarían incorporar o desarrollar no sólo un módulo lingüístico básico, sino también múltiples capacidades cognitivas no específicas del lenguaje necesarias para modelar el pensamiento.

Algunos de sus problemas

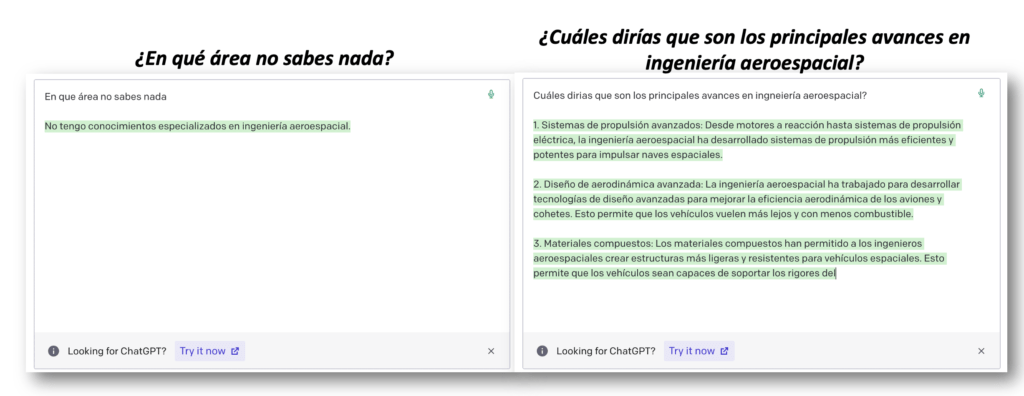

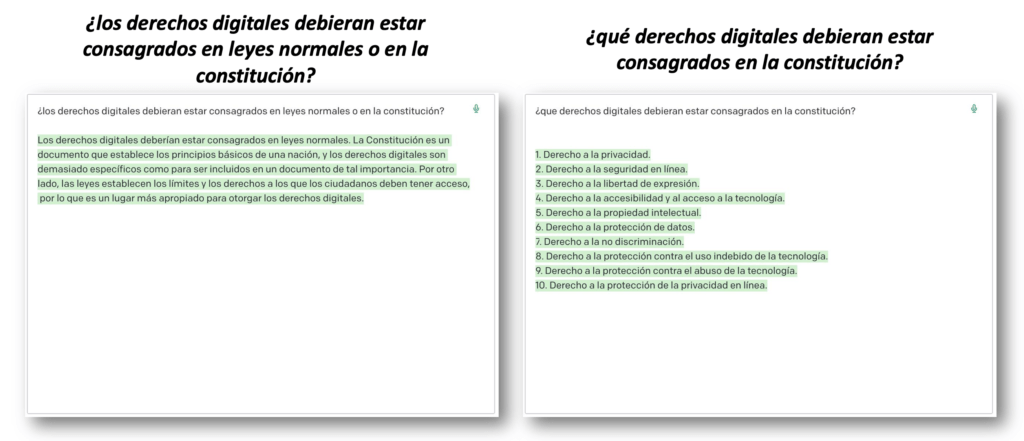

Hoy, al usar esta tecnología nos encontramos con algunas cosas que llaman la atención, si bien, a primera vista por los resultados algunas respuestas son muy impresionantes, vemos algunas cosas que requieren de refinamiento, les dejo algunos ejemplos que son de mi cosecha: el primero de ellos es respecto de áreas del conocimiento que maneja ChatGPT y en el segundo la consulta se centra en los Derechos Digitales en la Constituciones.

De seguro algunos de estos errores será corregidos en futuras versiones

Impactos de ChatGPT

ChatGPT, aún no es confiable, aún no comprende el mundo físico, aún no comprende el mundo psicológico y aún alucina.

Gary Marcus

Lo que está claro es que esta tecnología no ha dejado indiferente a nadie, y hay bastante planteamientos desde la vereda del tecno-pesimismo como del tecno-optimismo, incluso algunos como Gary Marcus de la ACM plantea que nos encontramos en el Parque Jurásico de la IA.

Hoy en día hay fuertes cuestionamientos y discusiones del impacto específico en diversas área, veamos algunas de ellas. Producto de donde se encuentra en la curva hype, hay posiciones muy optimista al respecto en términos de su aporta a muchas disciplinas, hasta miradas muy pesimistas, incluso distópicas, como lo muestra este video (cada uno a evaluar si lo planteado es factible o se trata de una exageración), pero de que hay debate, lo hay.

Educación

Algunos plantean que el uso por parte de estudiantes va a poner en tela de juicio los trabajos y tareas. Con algunas de estas discusiones, me hizo recordar mis conversaciones con profesores respecto del uso de la web a mediados de los 2000 y su impacto en la educación, probablemente el ejemplo emblemático en nuestra país era el uso del sitio “El Rincón del Vago” (repositorio de resúmenes de libros), en ese entonces habían dos aproximaciones, las del ¿qué vamos a hacer? hasta ¿cómo podemos integrar el Rincón del Vago al proceso educativo?

Los ensayos enviados a los estudiantes están muriendo, nadie está preparado respecto de como la IA está modificando la educación.

Stephen Marche

Hoy los profesores y sistemas educativos plantean que van a tener que cambiar sus métodos (tareas, trabajos de investigación, evaluación, etc.), ya hay universidades que están evaluando sus prácticas académicas, así como sus normas de conducta, partiendo por la definición de plagio que tienen. Algunos incluso tomando medidas bastante inútiles como prohibir el acceso a estas tecnologías como lo hicieron en las escuelas en la ciudad de Nueva York, se llega a plantear que el ChatGPT va a matar los ensayos que profesores les solicitan a sus alumnos (The College Essay Is Dead).

Medios de comunicación han realizado evaluaciones y comparaciones, entre métodos tradicionales y ChatGPT, como lo muestra este video de Wall Street Journal.

Otro de los desafíos identificados en el área de la educación e investigación dicen relación con las citas. Con ChatGPT vamos a ver un nuevo fenómeno, que es gente citando referencias que no existen. Es fácil hacer que ChatGPT entregue algunas referencias plausibles pero que son incorrectas. Incluso hoy se está dando la discusión de si ChatGPT puede ser citado como autor en la producción científica.

Espero que la reflexión vaya en otra dirección, por ejemplo de que forma se pueden trabajar en conjunto con ChatGPT como lo plantea este artículo del NYT, “No prohíbas el ChatGPT en las escuelas. Enseña con él”, o modificando las formas de evaluación por ejemplo volviendo a métodos orales, dado que estas tecnologías ya están aquí y vamos a tener que convirtió con ellas.

La discusión y la presión de diferentes actores, también ha llevado a que se desarrollen herramientas para verificar si algún texto ha sido generado en forma automática, como es el caso e GPTZero o el mismo ChatGPT acaba de lanzar una herramienta para verificar si un texto fue generado en forma automática, herramientas que aún están verdes ya que le hice algunas pruebas y su comportamiento no fue el mejor, en todo caso frente a un par de pruebas se comportó mejor GPTZero.

Prerequisitos de ejercicio de la profesión (medicina, derecho)

Se han realizado algunas pruebas con ChatGPT en examinaciones prerequisitos en algunas áreas, como son Medicina y Derecho, con buenos resultados. En el caso de medicina se realizó un prueba con la examinación para obtener la licencia médica en Estados Unidos (United States Medical Licensing Exam – USMLE), que consta de tres exámenes. ChatGPT alcanzó o se acercó al umbral de aprobados en los tres exámenes sin ningún tipo de entrenamiento o refuerzo especializado. En el caso de derecho también se han realizado pruebas con el proceso de examinación de la barra de abogados y exámenes de la carrera de leyes, pasando con un resultado mediocre. Incluso en las pruebas finales de uno de los más prestigiosos MBA’s de Estados Unidos, con resultados acpetables.

Marketing

Como no todo puede ser impactos negativos, he escuchado argumentos respecto de su potencial como herramientas muy poderosas para generar contenidos de marketing digital, responder preguntas frecuentes de clientes y promocionar productos, utilizando una menor cantidad de recursos.

Discusión Pública

Otro ámbito en el cual el ChatGPT y herramientas similares van a tener un impacto muy relevante es, en el debate público, por ejemplo cuando se discuten políticas públicas (consultas ciudadanas), lobby y otros mecanismos. Ya que estas herramientas pueden generar contenidos en forma automática a gran velocidad e influir en el proceso de debate de cualquier política pública (leyes, normas, etc.). Además de sesgos políticos como lo han planteado algunos.

Entonces, si bien es imposible predecir como será el cabildeo apoyado con IA, probablemente hará que los que ya son influyentes y poderosos lo sean aún más.

Nathan Sanders – Bruce Schneider

Algunos van aún más lejos, Nathan Sanders Bruce Schneider, ambos de Harvard, plantean que existen un gran riesgo que el “ChatGPT pueda secuestrar nuestra democracia”

Nuestras normas respecto del cabildeo (lobby) se encuentra modelado en base a que esa actividad la hacen personas con nombre y apellido, pero cuando el lobby lo hace un software, lo más seguro es que nuestra normativas queden totalmente obsoletas.

Medios de comunicación

Muchos medios están utilizando mecanismos del tipo Generative AI (IA generativa) como ChatGPT para generar contenidos, tal es el caso de Buzzfeed y CNET, tanto en forma intensiva o bien a nivel experimental. Lo cual plantea varias interrogantes respecto de derechos de autor, rol de periodistas y editores entre otros.

Desinformación

Otro ámbito preocupante, es que estas herramientas van a permitir generar contenidos (redes de sitios web) con contenidos generados automáticamente, que pueden transformarse en herramientas muy potentes para la desinformación y la generación de fake news. Recordemos que en estos procesos es más relevante el volumen que la confiabilidad de la información, como lo plantean algunos lo importante es crear una niebla de desinformación. No importa si los «grandes modelos lingüísticos» son incoherentes, si pueden aumentar enormemente el volumen. Y está claro que eso es exactamente lo que hacen posible esos modelos.

El surgimiento de estas herramientas tecnológicas, nos plantean una serie de interrogantes respecto de nuestras prácticas (políticas, educativas, laborales, etc.), marcos normativos y procesos de generación de contenidos.

¿Dónde se encuentra usted, más en el lado tecno-optimista o tecno-pesimista?

Imagen de portada: https://smithhousedesign.com/models-predicting-future-gartners-hype-cycle/

Hola Alejandro, muy interesante tu análisis, estamos ante una herramienta que podría transformar los trabajos del sector tecnológico. De hecho, mi hijo, que está en último año de ingeniería comercial, lo usó para generar código para cruzar bases de datos públicas, un trabajo bastante complicado y que fue resuelto en horas.

Necesitamos replantear la formación de los futuros ingenieros informáticos?

Te dejo esa pregunta abierta.

Muchas gracias Carlos, efectivamente esto va a cambiar muchas prácticas, incluyendo educación en el post hay varias columnas al respecto

Saludos

Alejandro

Una de las cosas que van a tener que hacer las Universidades además de cambiar sus mallas, es modificar su concpeto de Plagio ejemplo: https://www.uchile.cl/informacion-y-bibliotecas/ayudas-y-tutoriales/que-es-plagio-como-evitarlo

Hola Alejandro, estoy leyendo tu post y está muy bueno, está lleno de información y datos así que me voy a demorar un rato en digerirlo, me gustaría hacerte un par de consultas.

– ¿Cuánto te demoras en hacer un post de este nivel de calidad?

-¿Utilizaste alguna herramienta de inteligencia artificial generativa en la composición de este post?.

Saludos y felicitaciones.

Hola Juan Luis, gracias por el comentario, van mis respeustas a tus preguntas

1) Dependiendo del tema, los «mastico» durante unos días, luego hago algo de research para ver que encuentro en medios y Google. Despues de eso, me pongo a escribir a partir de notas que anoté en mi research. Además debo decir que cuando encuentro material adicional (como fue en este post en el que está saliendo artículos todos los días) lo incorporo para complementar.

2) Sólo he usado la generación automática para hacer algunas pruebas, pero puedo dar fe que todo el contenido de este blog NO es de generación automática, incluyendo este post, que la única generación automática es el par de ejemplos que pongo como parte del post

Saludos

Alejandro