Deepfakes: Cuando la realidad se vuelve opcional

Deepfakes ya no son una tecnología de ciencia ficción, están aquí y con resultados impresionantes, ¿estamos preparados para hacerles frente?

Hace solo unos años, las deepfakes eran una rareza, una forma ingeniosa (y a veces graciosa) de poner la cara de un actor en el cuerpo de otro, además con evidentes deficiencias técnicas y fáciles detectar, pero esto está cambiando y muy rápido.

Hoy, con los avances de la tecnología, la IA generativa y otros, son un arma poderosa que amenaza la confianza en lo que vemos y oímos. Esto sólo se va a poner peor a futuro.

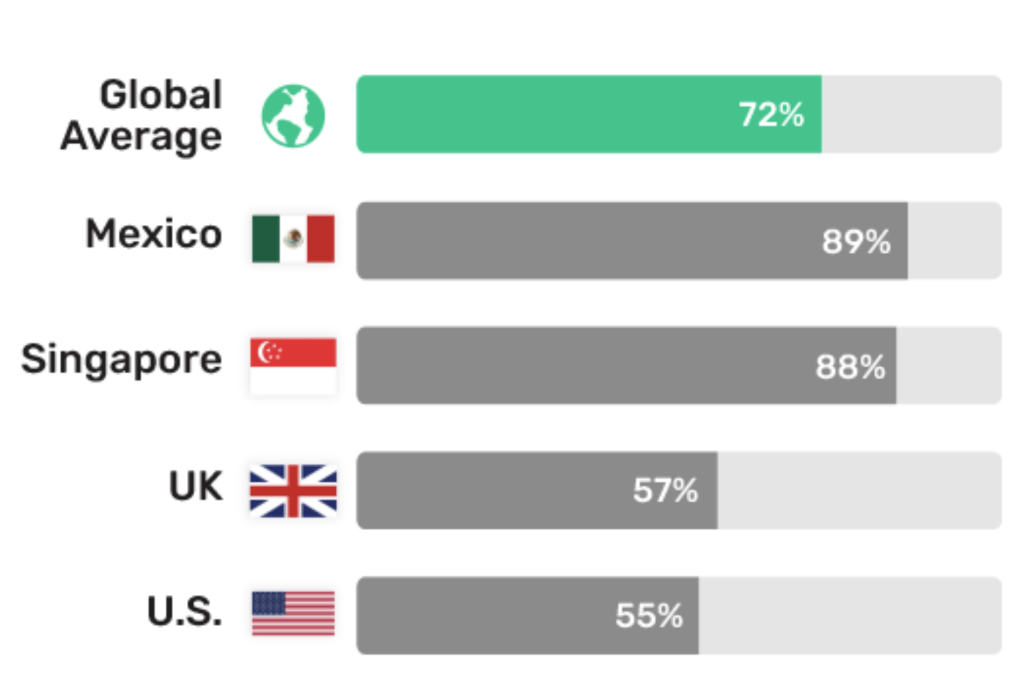

Un 72% de las personas encestadas les preocupa a diario ser engañados por un video hiperrealista o deepfake, y quieren que su gobierno haga más para regular la IA, según una encuesta de la empresa de eID Jumio en mayo de 2024. Según el estudio de Sumsub el crecimiento en la región de los fraudes basados en deepfakes han crecido en forma exponencial en los últimos años.

¿Cómo no preocuparse cuando la tecnología ha avanzado hasta el punto de que un software puede convertir una sola imagen en un video increíblemente realista, con gestos, expresiones y movimientos naturales?

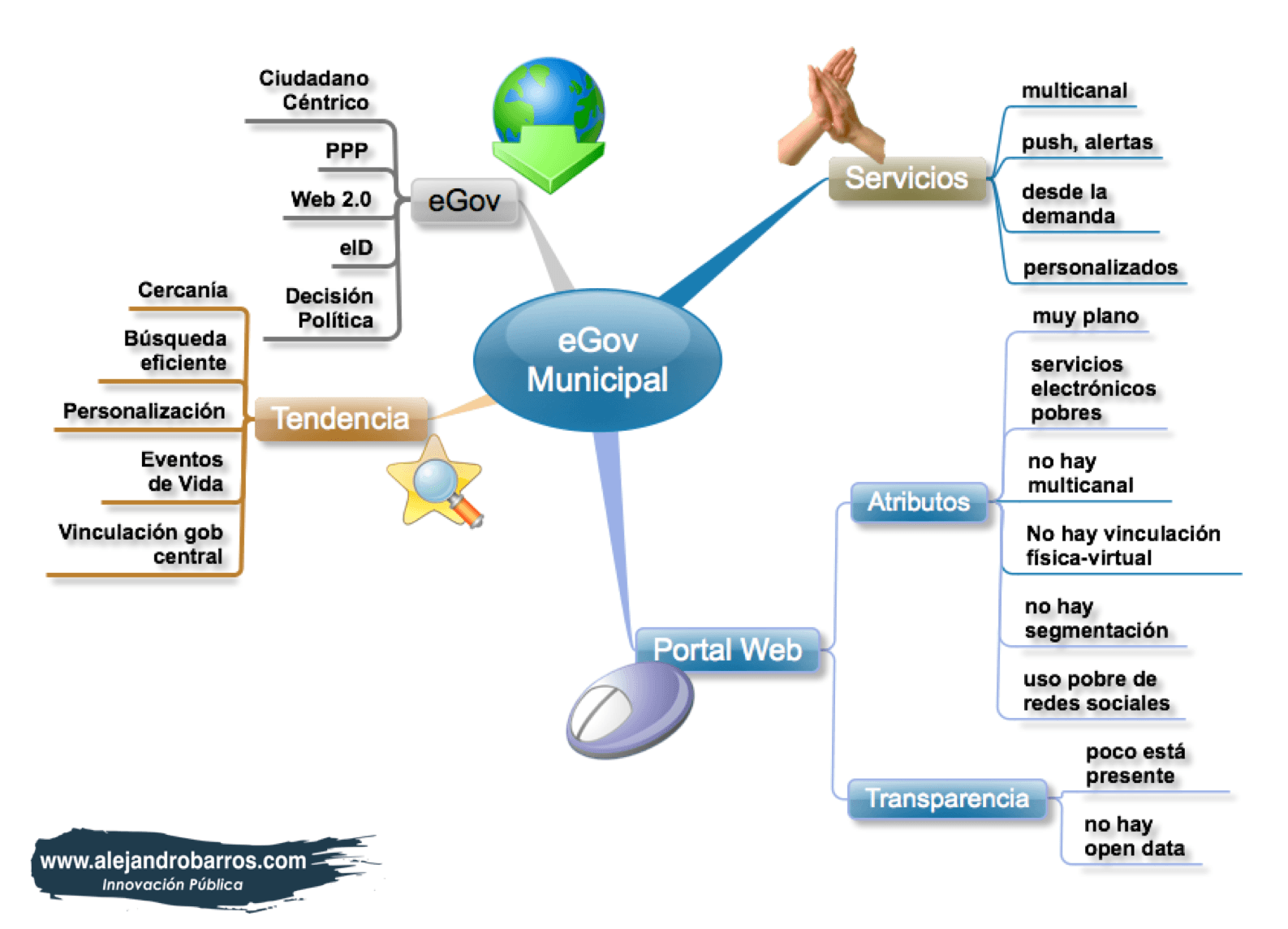

OmniHuman-1: El modelo que da miedo

Hace unos días fue anunciado el modelo de inteligencia artificial OmniHuman-1, desarrollado por la empresa ByteDance, los mismos de TikTok. Esta aplicación, permite convertir cualquier foto—una selfie, un retrato, incluso un dibujo animado—en un video en movimiento basado en audio o video de referencia, con una gran calidad. Esto significa que, con unos pocos clics, alguien podría hacer que cualquier persona diga y haga lo que sea, sin que nunca haya sucedido en la realidad. Aquí un ejemplo

Aquí les dejo el paper de los desarrolladores de la tecnologia detrás de OmniHuman-1, OmniHuman-1: Rethinking the Scaling-Up of One-Stage Conditioned Human Animation Models. Pueden encontrar más información de OmniHuman en su sitio Github, con múltiples ejemplos de lo que puede lograr esta tecnología.

Y este es solo un ejemplo. Empresas como Synthesia y HeyGen han llevado los avatares hiperrealistas a niveles impensados. Incluso la reconocida empresa de voces sintéticas ElevenLabs, logrando que sus voces sean prácticamente indistinguibles de las reales, y muchas otras.

Los deepfakes ya no son una simple curiosidad tecnológica: son un negocio multimillonario.

El problema: No es ciencia ficción, es un problema real

Si los avances en deepfakes se quedaran en la industria del entretenimiento, quizás no serían un problema tan grave. Pero la realidad es otra, con estas tecnologías se pueden:

- Manipulación política y desinformación: Un deepfake convincente de un líder mundial diciendo algo incendiario puede desencadenar una crisis diplomática antes de que se detecte la falsificación.

- Fraude y estafas millonarias: Empresas ya han sido engañadas por llamadas falsas de “CEOs” generadas con IA, ordenando transferencias de dinero a cuentas fraudulentas.

- Extorsión y reputación: Imagina recibir un video tuyo diciendo o haciendo algo que jamás hiciste. ¿Cuánto pagarías para evitar que se difunda?

- Ataques a la identidad: Con un solo video y una voz clonada, cualquier persona puede ser suplantada en llamadas, videollamadas e incluso en sistemas de autenticación biométrica.

¿Estamos listos para esta amenaza?

Los avances en regulación aún son lentos. Mientras algunos gobiernos buscan legislar el uso de deepfakes, la tecnología avanza sin frenos. La pregunta clave es:

¿cómo podemos protegernos en una era donde

la verdad es cada vez más fácil de falsificar?

Quizás la respuesta esté en una combinación de tecnología (herramientas de detección avanzadas), educación digital y un marco regulatorio más estricto.

Pero mientras las soluciones se implementan, una cosa es segura: ya no podemos confiar en lo que vemos.

¿Estamos preparados para este desafío o ya es demasiado tarde?

Observación: La imagen de portada corresponde a una imagen del paper OmniHuman-1: Rethinking the Scaling-Up of One-Stage Conditioned Human Animation Models